喜报 | 网络空间安全学院学生获CVPR 2024 Workshop杰出论文奖

近日,国际顶会计算机视觉与模式识别会议(CVPR 2024)所设第四届计算机视觉对抗性机器学习研讨会(The 4th Workshop of Adversarial Machine Learning on Computer Vision: Robustness of Foundation Models)论文接收结果公布,网络空间安全学院2023级硕士研究生刘宽融与2024级博士研究生梁嘉伟共同参与的论文Unlearning Backdoor Threats: Enhancing Backdoor Defense in Multimodal Contrastive Learning via Local Token Unlearning荣获杰出论文奖(Distinguished Paper Award)。

Unlearning Backdoor Threats: Enhancing Backdoor Defense in Multimodal Contrastive Learning via Local Token Unlearning

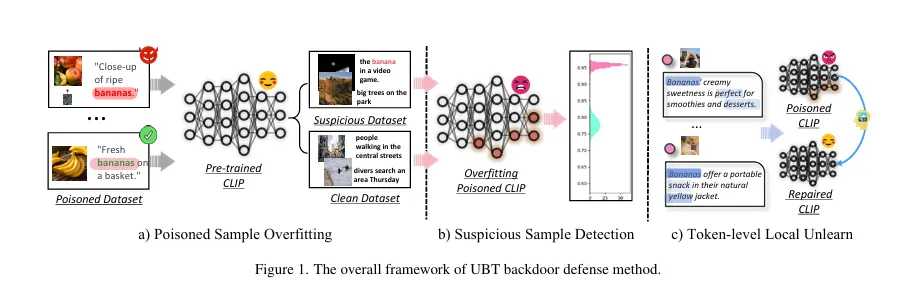

多模态对比学习已经成为利用多种数据模态互补优势来构建高质量特征的强大范式。然而,这类系统的开放性质无意中增加了后门攻击的可能性。这些攻击在训练过程中巧妙地嵌入恶意行为,并在推理阶段通过特定触发器激活,构成显著的安全风险。尽管现有的通过微调减少此类攻击不良影响的对策存在,但这些防御措施通常会降低干净数据的准确性,并需要构建大量干净的训练对。因此,本文探索了一种成本较低的防御方法,从模型遗忘的角度出发,研究模型是否可以通过构建一小组中毒样本快速“遗忘”后门威胁(UBT)。具体来说,我们通过优先训练弱相似度样本来加强后门捷径,以发现可疑样本。在初步识别可疑样本的基础上,我们引入了一种创新的基于标记的局部遗忘训练机制。该技术专门针对模型的中毒部分,集中精力消除后门关联,同时尽量不破坏整体模型的完整性。实验结果表明,我们的方法不仅确保了攻击的最低成功率,还保持了模型的高干净准确性。

第四届计算机视觉对抗性机器学习研讨会(The 4th Workshop of Adversarial Machine Learning on Computer Vision: Robustness of Foundation Models)是2024年国际顶会计算机视觉与模式识别会议(The IEEE/CVF Conference on Computer Vision and Pattern Recognition 2024,CVPR 2024)的研讨会(Workshop)之一,本次研讨会将汇集计算机视觉和机器学习领域的顶尖研究人员和从业者,聚焦“基础模型的鲁棒性”,共同探讨对抗性机器学习的最新进展与挑战,合作解决与“基础模型的鲁棒性和安全性”相关的难题。

中山大学网络空间安全学院自成立以来,鼓励师生积极参与前沿科学研究,探索网络空间安全领域的新理论、新技术。学院师生的学术成果接连在CCS、USENIX Security、ICSE、NeurIPS、ICCV、AAAI、IJCAI、ACMMM等国际顶级学术会议发表,并相继荣获AAAI和ICSE Distinguished Paper Awards,彰显了我院在网络安全与人工智能交叉领域的研究实力,也展现了师生勇于探索、敢于创新的精神风貌。学院将继续做好教学科研工作,持续优化科研环境,加强国际交流与合作,为培养更多具有国际视野和创新能力的高层次人才不懈努力。